2026年4月10日 北京

一、开篇引入

在2026年的AI编程浪潮中,“

许多人用着云端AI编程工具,却始终面临三大痛点:

本文由浅入深,从痛点切入,讲解核心概念与原理,提供可运行的代码示例,最后提炼高频面试要点。目标只有一个:让你看完后,既能动手搭,也能讲得清。

系列预告:本文聚焦“离线AI编程助手”的技术原理与本地部署,下一篇将深入推理引擎优化与模型微调实战。

二、痛点切入:为什么需要离线AI编程助手?

先看一个典型场景:在金融公司写Python数据处理脚本,公司明文规定所有代码不得上传外网。打开VS Code,装好GitHub Copilot,输入import pandas as pd,等AI推荐下一行——结果呢?网络不通,没法用。

即使网络通,云端方案依然存在硬伤:

隐私风险:三星工程师曾把机密代码粘贴到云端AI工具中,导致公司紧急内部封禁-6。药物研究员的未公开试验数据、量化交易公司的核心策略代码,都曾在不经意间流向第三方服务器。

成本压力:主流云端AI编程助手月费10到19美元,每年120到228美元-33。团队每人每月扣一笔,年终一看,相当于少请了一个实习生。

网络依赖:飞机上、高铁隧道里、内网隔离环境——想写代码还得先联网,这叫什么事?

传统云端方案的代码补全模式:

// 在VS Code中敲代码时,云端AI助手做的操作: // 1. 编辑器把光标前后的代码(上下文)打包 // 2. 通过HTTPS发送到云端服务器 // 3. 服务器上的大模型推理后返回建议 // 4. 编辑器渲染建议供你按Tab接受 // // 问题:步骤2是黑盒——你的代码去了哪里?谁看过?被训练了?

云端方案的三大缺点一目了然:

数据主权丧失:代码离开你的机器,你就失去了控制权。

供应商锁定:涨价了、改模型了、服务宕机了,你只能被动接受-33。

高额持续成本:年费订阅对个人开发者和小团队不友好-11。

正是在这个背景下,离线AI编程助手应运而生——它的核心设计初衷很简单:让AI推理在本地完成,代码永远不离开你的机器。

三、核心概念讲解:离线AI编程助手

标准定义:

Offline AI Coding Assistant(离线AI编程助手) 是指完全在用户本地设备上运行、无需外部网络连接的AI编程辅助工具。所有代码处理、模型推理和数据存储均在本地完成。

拆解关键词:

离线(Offline) :推理时不需要联网。首次下载模型可能需要网络,但之后全程可离线工作。

AI编程(AI Coding) :基于大语言模型,提供代码补全、代码生成、代码解释、代码重构等能力。

助手(Assistant) :辅助开发者,而非替代开发者。最终决策权在你手中。

生活化类比:

云端AI助手就像公共厨房:食材(你的代码)带进去,厨师(云模型)帮你切菜炒菜,但做完你端走,厨房里留下了你的食材信息。

离线AI助手就像自家厨房:冰箱里的食材自己家的,自己切自己炒,整个过程不出家门半步。

作用与价值:

数据主权:代码100%保留在本地,彻底消除泄露风险。

零成本持续使用:无订阅费,一次部署终身可用-33。

离线可用:飞机、高铁、内网隔离环境照常工作。

可定制性:可以自己换模型、调参数、对接企业规范。

四、关联概念讲解:云端AI编程助手

标准定义:

Cloud-based AI Coding Assistant(云端AI编程助手) 是指将代码上下文发送到云端服务器,由远程大模型进行推理并返回结果给本地编辑器的AI编程工具。

它跟离线AI编程助手的关系:

云端方案是“集中式服务”,离线方案是“分布式本地化”。前者追求“随时可用的便利性”,后者追求“彻底可控的自主权”。两者是同一技术目标下的两种实现路径,而非相互替代的关系。

云端 vs 离线 核心差异对比:

| 维度 | 云端AI编程助手 | 离线AI编程助手 |

|---|---|---|

| 数据存储 | 代码发送到第三方服务器 | 代码完全留在本地 |

| 网络需求 | 必须联网 | 可完全离线 |

| 成本模型 | 月费/年费订阅制 | 一次性部署(零持续费用) |

| 响应延迟 | 200~500ms(依赖网络质量) | 50~200ms(本地推理) |

| 模型可定制 | 固定模型,不可更换 | 可任意更换开源模型 |

| 硬件要求 | 几乎无要求(云端计算) | 需要本地GPU/足够内存 |

云端方案的运行机制示例:

用户敲代码 → VS Code插件捕获上下文 → 打包发送到云端API → 云端大模型推理 → 返回JSON建议 → 编辑器渲染 → 用户决定接受或拒绝

五、概念关系与区别总结

一句话概括:离线AI编程助手是“思想与实现”的统一体——它既是“代码不离开本地”的安全理念,也是通过本地推理引擎和开源模型实现这一理念的具体技术方案。

云端方案与离线方案的关系:

云端 = 用便利换安全与控制权

离线 = 用硬件换自主与隐私权

快速记忆卡片:

云端:联网、付费、代码出去、别人托管。

离线:可断网、免费、代码留下、自己把控。

六、代码/流程示例演示

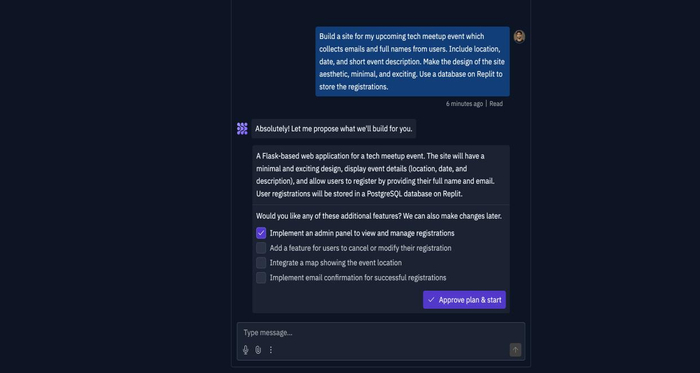

以 VS Code + Ollama + Continue 组合为例,完整演示如何搭建一个离线AI编程助手-33。

6.1 核心组件说明

Ollama:本地LLM推理服务器,负责在本地运行大模型。

Continue:VS Code插件,连接Ollama并提供代码补全与对话界面。

Qwen2.5-Coder:阿里开源的编程专用模型,支持7B参数,兼顾性能与精度。

6.2 安装与配置

Step 1:安装 Ollama 并下载模型

macOS / Linux / Windows (WSL) 通用 访问 https://ollama.com 下载安装包,或使用命令行安装 验证Ollama服务是否运行(默认端口11434) curl http://localhost:11434 下载编程专用模型 Qwen2.5-Coder 7B(约4GB) ollama pull qwen2.5-coder:7b 如需更轻量的补全模型(1.5B,约1GB) ollama pull qwen2.5-coder:1.5b

Step 2:在VS Code中安装 Continue 插件

打开VS Code,进入扩展商店(Ctrl+Shift+X)

“Continue”并安装

安装完成后,左侧会出现Continue图标

Step 3:配置 Continue 连接本地 Ollama

编辑 Continue 配置文件 ~/.continue/config.json:

{ "models": [ { "title": "Qwen-Coder (Local)", "provider": "ollama", "model": "qwen2.5-coder:7b", "apiBase": "http://localhost:11434" } ], "tabAutocompleteModel": { "title": "Qwen-Coder (Fast)", "provider": "ollama", "model": "qwen2.5-coder:1.5b", "apiBase": "http://localhost:11434" } }

关键注释:

models配置聊天对话用的主模型(7B,质量更高)tabAutocompleteModel配置Tab补全用的轻量模型(1.5B,响应更快)apiBase: localhost:11434意味着所有请求都发往本机的Ollama,绝不外发

Step 4:测试离线运行

新建一个test.py文件,输入以下内容,然后按Tab键等待补全 def calculate_fibonacci(n): """计算斐波那契数列的第n项""" if n <= 1: return n return calculate_fibonacci(n-1) + calculate_fibonacci(n-2) 在这里,离线AI助手会自动补全后续代码

执行流程解析:

你在VS Code中输入代码片段

Continue插件捕获光标位置和上下文

插件向本地Ollama服务(

localhost:11434)发送HTTP请求Ollama使用已下载的Qwen2.5-Coder模型进行推理

推理结果返回给Continue,在编辑器中显示灰色建议

你按Tab键接受,按Esc忽略——整个过程0流量出本地

七、底层原理/技术支撑

离线AI编程助手之所以能在2026年走向成熟,底层依赖三大技术基石:

7.1 本地推理引擎:Ollama 与 llama.cpp

Ollama底层基于llama.cpp项目,后者是一个用C++实现的高效LLM推理库。它的核心价值在于让消费级GPU也能跑大模型。llama.cpp在2026年初稳定支持Metal(苹果)和CUDA(NVIDIA)后端,模型管理、上下文窗口处理都不再需要手动调参-41。

简单的原理图示:

GGUF量化模型文件 → llama.cpp加载 → 利用GPU/CPU并行计算 → 生成下一个Token7.2 模型量化技术

GPT这类模型动辄几十GB,普通电脑装不下。量化技术(Quantization)通过降低参数精度(如FP16→INT4)来压缩模型体积,用极小的精度损失换取巨大的内存节省。

2026年主流的GGUF Q4_K_M和Q5_K_M量化格式,在4-5bit精度下保留了绝大多数代码生成质量-41。

7.3 消费级硬件进化

NVIDIA RTX 5090配备32GB GDDR7显存,可完整加载33B参数级别的量化模型-41。

Apple M系列芯片的统一内存架构,让MacBook也能流畅运行70亿参数模型-33。

一句话总结:量化把模型“瘦身”,推理引擎让“瘦身”后的模型跑得动,硬件升级让更多开发者用得起。这三者缺一不可。

八、高频面试题与参考答案

面试题1:离线AI编程助手和GitHub Copilot的本质区别是什么?

参考答案(踩分点:架构差异 → 数据流向 → 优劣势对比):

本质区别在于数据流向。GitHub Copilot是云端SaaS方案,代码上下文会通过网络发送到微软的服务器进行推理,属于“集中式计算”。离线AI编程助手(如Tabby、Continue+Ollama)是本地自托管方案,所有推理在用户自己的设备上完成。

优势:离线助手彻底消除数据泄露风险,无持续订阅费用,可在完全隔离的内网环境中运行-33。

劣势:需要本地硬件资源(GPU/内存),大模型推理质量可能略逊于云端顶级闭源模型。

面试题2:本地部署AI编程助手需要什么硬件配置?

参考答案(踩分点:分层配置 → 模型规模对应 → 苹果芯片特点):

分三层:

最低配置:8GB RAM + 任何近5年CPU,可跑1.5B参数轻量模型用于基础补全。

推荐配置:16GB+ RAM + 至少6GB VRAM的NVIDIA GPU(RTX 3060及以上),可流畅运行7B参数模型。

高性能配置:32GB+显存(如RTX 5090)可跑33B参数模型-41。

特别说明:Apple M系列芯片利用统一内存架构,16GB的M1性能堪比PC端独立显卡配置-33。

面试题3:Ollama在本地AI编程架构中扮演什么角色?

参考答案(踩分点:定位 → 核心功能 → 与上下游关系):

Ollama是本地LLM推理服务器,扮演模型运行时(Model Runtime)的角色。它的核心功能:

管理开源模型的下载、存储和版本

基于llama.cpp提供GPU加速的推理服务

暴露RESTful API(默认localhost:11434)供插件调用

在技术栈中,它的上游是Continue/Cline等IDE插件,下游是GGUF格式的开源模型文件。三者形成“插件 → Ollama → 模型”的调用链路-33。

面试题4:GGUF量化是什么?为什么对离线AI编程很重要?

参考答案(踩分点:定义 → 作用 → 典型配置):

GGUF是llama.cpp项目使用的模型量化格式。它将模型参数从16位浮点数压缩到4-5位整数(Q4_K_M/Q5_K_M),将模型体积压缩到原来的1/4到1/3,同时保持90%以上的生成质量。

对离线AI编程的意义:没有量化,70亿参数的模型需要约14GB显存;量化后仅需约4GB,普通消费级GPU即可运行,让离线编程助手真正走向大众。

九、结尾总结

回顾全文核心知识点:

✅ 为什么需要离线AI编程助手——云端方案存在隐私风险、持续成本、网络依赖三大痛点。

✅ 核心概念——离线方案让代码推理在本地完成,数据永不外流。

✅ 云端 vs 离线对比——用便利换安全,还是用硬件换自主,需要根据场景权衡。

✅ 实战配置——Ollama + Continue + Qwen2.5-Coder,30分钟搭建完全离线的Copilot替代方案-33。

✅ 底层原理——推理引擎(Ollama/llama.cpp)+ 量化技术(GGUF)+ 硬件升级,三者共同支撑2026年本地AI编程走向成熟。

面试易错点:

不要说“离线AI助手不用模型”——它要用模型,只是模型在本地跑。

不要说“离线=不用GPU”——即使量化后,GPU加速依然能显著提升推理速度。

不要把Ollama和Continue混为一谈——一个是推理引擎,一个是IDE插件,角色不同。

下一篇预告:我们将深入推理引擎的优化技巧——如何通过调整上下文长度、批处理大小和模型分载策略,让离你跑出专业级的响应速度。

一句话记住本文:离线AI编程助手 = 本地推理引擎 + 量化模型 + IDE插件,让代码AI“不出家门”也能干活。

相关文章

最新评论